人工智能的崛起并非一蹴而就,其核心驅(qū)動力——機器學(xué)習(xí)的發(fā)展歷程與關(guān)鍵技術(shù)共同編織了今天的智能時代。本文將從歷史脈絡(luò)與軟硬件技術(shù)開發(fā)兩方面,全面解析這一領(lǐng)域的演進與突破。

一、機器學(xué)習(xí)的發(fā)展歷史

機器學(xué)習(xí)的起源可追溯至20世紀中葉。1950年代,艾倫·圖靈提出“機器能思考嗎?”的命題,奠定了理論基礎(chǔ)。1956年達特茅斯會議正式提出“人工智能”概念,早期機器學(xué)習(xí)聚焦于符號主義方法,如決策樹和規(guī)則系統(tǒng)。

1970-1980年代,由于計算能力限制和“AI寒冬”,進展緩慢,但統(tǒng)計學(xué)習(xí)方法開始萌芽。1990年代,支持向量機(SVM)和貝葉斯網(wǎng)絡(luò)等技術(shù)興起,機器學(xué)習(xí)從理論走向?qū)嵺`。

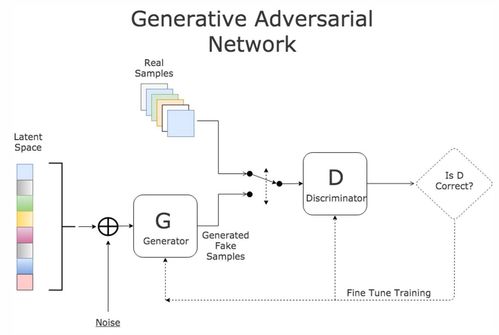

21世紀初,大數(shù)據(jù)和計算硬件的進步催生了深度學(xué)習(xí)革命。2012年,AlexNet在ImageNet競賽中奪冠,標志著深度學(xué)習(xí)時代的開啟。隨后,強化學(xué)習(xí)、生成對抗網(wǎng)絡(luò)(GAN)等不斷拓展邊界,推動人工智能在圖像識別、自然語言處理等領(lǐng)域的應(yīng)用。

二、關(guān)鍵技術(shù)解析

機器學(xué)習(xí)的關(guān)鍵技術(shù)可分為算法、軟件框架和硬件支持三大部分。

- 核心算法演進:

- 監(jiān)督學(xué)習(xí):如線性回歸、神經(jīng)網(wǎng)絡(luò),依賴標注數(shù)據(jù)訓(xùn)練模型。

- 無監(jiān)督學(xué)習(xí):如聚類(K-means)和降維(PCA),用于發(fā)現(xiàn)數(shù)據(jù)內(nèi)在結(jié)構(gòu)。

- 強化學(xué)習(xí):通過試錯機制優(yōu)化決策,應(yīng)用于游戲AI和機器人控制。

- 深度學(xué)習(xí):基于多層神經(jīng)網(wǎng)絡(luò),在計算機視覺和語音識別中表現(xiàn)卓越。

- 軟件框架與工具:

- 開源框架如TensorFlow、PyTorch和Scikit-learn降低了開發(fā)門檻,支持模型構(gòu)建、訓(xùn)練和部署。

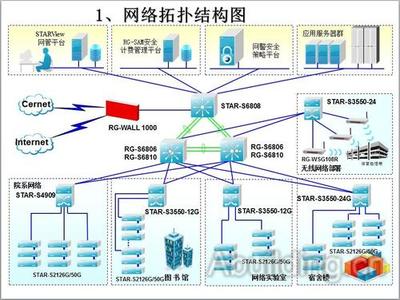

- 云計算平臺(如AWS、Google Cloud)提供彈性計算資源,加速大規(guī)模數(shù)據(jù)處理。

- 自動化機器學(xué)習(xí)(AutoML)工具簡化了模型選擇與調(diào)參過程。

- 硬件技術(shù)開發(fā):

- GPU與TPU:圖形處理單元和張量處理單元專為并行計算設(shè)計,大幅提升訓(xùn)練效率。

- 專用芯片:如FPGA和ASIC,針對特定算法優(yōu)化,實現(xiàn)低功耗高性能。

- 邊緣計算設(shè)備:將機器學(xué)習(xí)部署到終端設(shè)備,減少延遲并保護隱私。

三、未來展望

機器學(xué)習(xí)正與物聯(lián)網(wǎng)、量子計算等融合,軟硬件協(xié)同創(chuàng)新將持續(xù)推動人工智能普及。倫理與可解釋性成為新焦點,確保技術(shù)發(fā)展與社會需求平衡。

機器學(xué)習(xí)的歷史是算法與工程交織的旅程,關(guān)鍵技術(shù)從理論到落地,依賴計算機軟硬件的持續(xù)進化。未來,這一編織過程將創(chuàng)造更智能、更高效的世界。